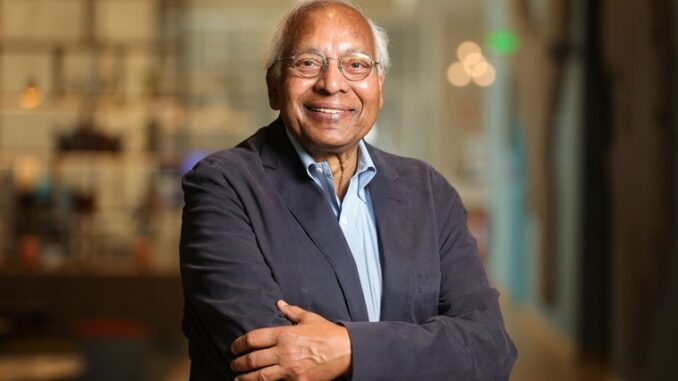

Cuando era niño, el investigador indio Anil Jain (Basti, 1948) no estaba especialmente interesado por la tecnología. No recuerda ningún momento de película en el que de repente, algo captó todo su interés hasta el punto de hacerle tomar la decisión de dedicar su vida al desarrollo de la tecnología. En su caso, si terminó siendo ingeniero fue en buena medida porque era lo que se esperaba de él, que siguiese los pasos de su abuelo, su padre y sus tíos, que también lo habían sido. «Estaba asumido que yo recorrería el mismo camino. Nunca hubo debate sobre si estudiaría otra carrera, como Ciencias Políticas o Periodismo. No tenía ni idea de a qué me iba a dedicar después de terminar los estudios», recuerda ahora, tantos años después, en conversación con ABC. De lo que el científico no tenía dudas es de que hiciese lo que hiciese, sirviese para algo; y ya, de paso, que también le ayudase a alcanzar cierto reconocimiento. Y vaya si lo consiguió. Desde hace años está considerado como uno de los padres de la biometría moderna y principal culpable, entre otras muchas, muchísimas cosas, de que, de un tiempo a esta parte, no haya móvil en el mercado que no incorpore tecnología de reconocimiento facial o dactilar. Logro que le ha servido para ser reconocido recientemente, junto a su colega Michael I. Jordan, con el premio Fronteras del conocimiento de la Fundación BBVA correspondiente a este 2025.MÁS INFORMACIÓN noticia No Premio Fronteras del Conocimiento a los investigadores Anil Jain y Michael I. Jordan por impulsar la biometría y la IA«Antes de 2013, cuando salió a la venta el iPhone 5S, la gente llevaba sus móviles desbloqueados y sin medidas de seguridad. Incluso cuando la gente usaba un PIN para bloquear su dispositivo, las contraseñas más comunes eran extremadamente fáciles de adivinar, como ‘1234’ o ‘4567’. Si un teléfono no está protegido con biometría, con la huella o el rostro del usuario, desbloquearlo es un juego de niños», señala el experto, que llama la atención sobre la gran seguridad de los sistemas de reconocimiento facial y dactilar a día de hoy. Todavía siguen mejorando, pero que nadie se piense que la tecnología que hay detrás es perfecta. Puede cometer errores, y en algunos caso, incluso, llegar a truncar vidas.Error en el 11MDesde los inicios de su carrera como investigador, Jain estuvo volcado en intentar enseñar a las máquinas a reconocer patrones y diferencias. En la década de los sesenta desarrolló herramientas con las que el ejército de Estados Unidos podía saber fácilmente si un avión en el cielo era de su propiedad o pertenecía a un potencial enemigo del país. De ahí pasó a estudiar cómo discernir si las imágenes médicas mostraban el indicio de alguna enfermedad, y después a mostrar a un ordenador a reconocer la dirección a la que se enviaba una carta postal. Sin embargo, el trabajo con el que el indio se convirtió en referencia dentro de la comunidad científica no llegó hasta los años noventa, cuando creó una máquina capaz de detectar la coincidencia entre dos huellas dactilares 100 veces más rápido de lo que era posible hasta entonces. El ingenio dio de sí para el registro de seis patentes. Y sin este todavía, a día de hoy, los usuarios probablemente seguirían dibujando patrones con el dedo sobre las pantallas sus teléfonos para poder desbloquearlos. Además, el ingeniero demostró que, aunque es complicado que ocurra, las huellas de dos personas diferentes pueden pasar por la misma ante un sistema biométrico. En base a esto, ¿debería preocuparnos que haya gente encerrada en la cárcel por un error de esta clase? «Sí que debería preocuparnos que haya inocentes en la cárcel por un fallo, porque de hecho ya los ha habido», explica Jain.El investigador apunta directamente a un caso ocurrido a raíz de los atentados islamistas con bomba del 11 de marzo de 2004 en Madrid. Pero el fallo no tuvo lugar en España, sino en Estados Unidos. Brandon Mayfield , abogado musulmán nativo del estado de Oregón, fue detenido por el FBI y pasó dos semanas encarcelado después de que, erróneamente, la agencia norteamericana creyese haber encontrado una huella dactilar del jurista en las bolsas con detonadores relacionadas con la masacre. Años después recibió una disculpa pública y una compensación de dos millones de dólares.EL abogado Brandon Mayfield en una imagen de archivo«Cuando la calidad de la muestra no es buena (como ocurrió en el caso de Mayfield) no deberíamos confiar únicamente en la coincidencia, ya que puede haber errores. Por ello, es recomendable utilizar información adicional. Por ejemplo, hoy en día los teléfonos móviles cuentan con GPS, ¿cierto? Esto permite determinar si una persona estaba cerca del lugar donde ocurrió un acto delictivo. Este ha sido un desafío para las agencias forenses y la policía, que ahora entienden que no pueden depender únicamente de la decisión humana o de una máquina», dice Jain. Durante los últimos años, numerosos científicos y juristas se han mostrado preocupados por los potenciales fallos de la tecnología biométrica y las consecuencias que estos pueden traer a ciudadanos inocentes. Porque el caso de Mayfield no es único, y tampoco el más reciente.Robert Williams, un afroamericano de 42 años, fue arrestado en enero de 2020 frente a su hogar en Detroit debido a una identificación errónea por parte de un sistema de reconocimiento facial. Las imágenes de una cámara de vigilancia de una tienda de lujo fueron comparadas mediante este sistema, que lo señaló incorrectamente como el presunto perpetrador de un robo. Williams fue detenido durante 30 horas antes de que las autoridades reconocieran el error y lo liberaran.También en el país norteamericano, pero un año antes, en 2019, Ousmane Bah , un joven de Nueva York, demandó a Apple por 1.000 millones de dólares alegando que un error en el sistema de reconocimiento facial de la compañía lo vinculó con una serie de robos en las tiendas de la propia firma de la manzana. Según la demanda, el verdadero ladrón utilizó una identificación perdida de Bah y, debido a un fallo en el sistema, su rostro fue asociado incorrectamente con los delitos, lo que llevó a su arresto. Finalmente fue liberado. La compañía del iPhone negó que recurriese a esta clase de tecnología en sus comercios.Sea como sea, Jain lo tiene claro. Aunque el reconocimiento facial y dactilar están muy desarrollados, ni son perfectos ni espera que lo vayan a ser en el futuro: «Bueno, nunca habrá un sistema perfecto, porque los humanos (que somos los que los hacemos) nunca hemos sido perfectos. No importa lo bien que funcione nuestro sistema visual humano, siempre cometemos algunos errores. A veces puedes estar caminando por un centro comercial y, de repente, ves a una persona que crees que es tu amigo, y comienzas a hablar con él, y luego te das cuenta de que, oh, cometiste un error. ¿Verdad?». El experto completa esta afirmación señalando, en lo que respecta al reconocimiento facial, que «si las imágenes (capturadas por las cámaras) son perfectas, probablemente (la máquina) no cometerá un error». Lo importante cuando se recurre a estas herramientas con fines policiales, es tener claro que la calidad de los datos es óptima y que el rango de error en la identificación es lo más limitado posible. Seguridad vs. privacidadDurante los últimos años, varios países han recurrido a la tecnología de reconocimiento facial como medio a través del que mantener la seguridad y controlar a la población en espacios públicos. A la cabeza se encuentra China , que es el país con el sistema de cámaras más avanzado y extendido del mundo. Desde 2017 aproximadamente, el estado cuenta con millones de cámaras con inteligencia artificial (IA) que identifican ciudadanos en tiempo real. Pekín recurre a esta tecnología para definir el crédito social de los habitantes del país, el objetivo es premiar a los que tienen buenos comportamientos y castigar a los que no, que pueden quedarse, incluso, sin servicios básicos. También ha sido empleada para controlar férreamente a la minoría musulmana uigur.Otros países que recurren a esta tecnología, aunque en menor medida, son Rusia, Irán o Emiratos Árabes. En Estados Unidos se emplea en algunas ciudades con fines policiales. También está presente con este fin en la británica Londres. ¿Dónde debería estar marcado el límite entre seguridad y privacidad?«Ese es un tema de gran discusión», señala Jain. « Para determinar dónde está el límite, depende del tipo de aplicación de la que estemos hablando. Si se trata de usar esta tecnología por seguridad en un reactor nuclear, para la defensa del país o de sitios donde haya implicaciones para la seguridad nacional, tiene sentido. Pero si estamos hablando de que un establecimiento como McDonald’s tengo esto para vigilar a la gente que va a tomar una hamburguesa, entonces no lo tiene», prosigue el experto.Dicho esto, el investigador se muestra muy en contra del uso que hacen actualmente de la biometría estados como China. Y es muy claro al respecto: «Bueno, en una sociedad abierta eso no debería estar ocurriendo. Pero en ciertos países, dado su sistema político, pueden utilizar la tecnología de esta forma». Jain apunta, además, que algunos estados pueden recurrir a esta tecnología para seguir los movimientos de los visitantes extranjeros que entran por sus fronteras: «Siempre ha existido el espionaje y el rastreo humano, pero ahora también pueden hacerlo mediante cámaras. Si un país tiene cientos de millones de cámaras, es muy fácil rastrear a una persona mientras se mueve de un lugar a otro, porque siempre estará bajo la vista de alguna cámara. Así que, lamentablemente, esto es algo que depende de cada país, y no existe un organismo internacional que pueda regularlo o controlarlo».A pesar de ello, el indio pone en valor el trabajo que ha realizado la Unión Europea a la hora de controlar cómo los estados pueden hacer uso de esta herramienta en suelo comunitario. La Ley de IA, aprobada a inicios del año pasado, recoge que el reconocimiento facial en espacios públicos en tiempo real está prohibido de forma general, y únicamente puede ser empleado en casos muy concretos, como la búsqueda selectiva de una persona desaparecida o la prevención de un atentado terrorista.

Dejar una contestacion